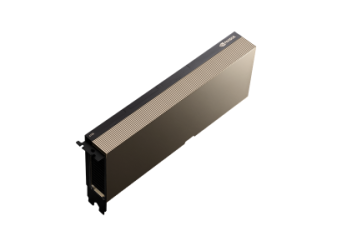

NVIDIA A100 80GB

- Architektura GPU NVIDIA Ampere

- Akcelerator GPU zoptymalizowany do AI, HPC i centrów danych

- 6912 rdzeni NVIDIA CUDA do równoległych obliczeń

- 432 rdzenie Tensor do przyspieszania treningu i inferencji modeli AI

- 80 GB pamięci HBM2e z ECC do obsługi dużych modeli i zbiorów danych

- Przepustowość pamięci do 1,935 GB/s

- Interfejs PCIe 4.0 x16 zapewniający wysoką przepustowość komunikacji

- Pasywne chłodzenie przystosowane do serwerów i systemów obliczeniowych

- Maksymalny pobór mocy: 300 W

Darmowa dostawa

Promocja cenowa na model HDR-15-5

Produkt przeznaczony wyłącznie do zastosowań profesjonalnych

NVIDIA A100 80GB

Opis

NVIDIA A100 80GB - akcelerator GPU dla AI i centrów danych

Procesor graficzny NVIDIA A100 Tensor Core GPU zapewnia wyjątkową wydajność obliczeniową dla najbardziej wymagających środowisk centrów danych. Zaprojektowany w oparciu o architekturę NVIDIA Ampere, układ A100 stanowi fundament nowoczesnych platform obliczeniowych wykorzystywanych w sztucznej inteligencji, analizie danych oraz obliczeniach wysokiej wydajności (HPC).

Model NVIDIA A100 80GB oferuje ogromną przestrzeń pamięci GPU oraz jedną z najwyższych przepustowości pamięci dostępnych w akceleratorach serwerowych. Dzięki temu może obsługiwać najbardziej wymagające modele AI, ogromne zbiory danych oraz złożone symulacje obliczeniowe. GPU zapewnia nawet 20-krotnie wyższą wydajność w porównaniu z poprzednimi generacjami akceleratorów centrów danych.

Architektura NVIDIA Ampere i Tensor Cores

GPU A100 wyposażony jest w 6912 rdzeni CUDA oraz 432 rdzenie Tensor, które przyspieszają operacje macierzowe wykorzystywane w uczeniu maszynowym i deep learningu. Dzięki temu akcelerator doskonale radzi sobie zarówno z trenowaniem modeli AI, jak i z ich inferencją w środowiskach produkcyjnych.

Dodatkowo 80 GB pamięci HBM2e z korekcją błędów ECC oraz przepustowość przekraczająca 1,9 TB/s umożliwiają przetwarzanie ogromnych zbiorów danych oraz bardzo dużych modeli sztucznej inteligencji.

MIG - wiele instancji GPU w jednym akceleratorze

Jedną z kluczowych technologii NVIDIA A100 jest Multi-Instance GPU (MIG), która pozwala podzielić pojedynczy akcelerator na do siedmiu niezależnych instancji GPU. Każda instancja może obsługiwać oddzielne obciążenia obliczeniowe, zapewniając izolację zasobów oraz maksymalne wykorzystanie sprzętu.

Dzięki technologii MIG możliwe jest efektywne wykorzystanie GPU w środowiskach chmurowych, platformach AI oraz centrach danych obsługujących wiele równoległych zadań.

Akcelerator dla nowoczesnych systemów AI

NVIDIA A100 jest szeroko stosowany w infrastrukturze sztucznej inteligencji, gdzie wymagana jest ogromna moc obliczeniowa oraz wysoka przepustowość pamięci. Akcelerator ten jest wykorzystywany między innymi do:

- trenowania dużych modeli językowych LLM (Large Language Models)

- systemów multimodalnych VLM (Vision Language Models)

- platform Retrieval Augmented Generation (RAG)

- analizy dużych zbiorów danych

- inferencji modeli AI w środowiskach produkcyjnych

- systemów rekomendacyjnych i analitycznych

Dzięki wysokiej wydajności Tensor Cores oraz ogromnej przepustowości pamięci, NVIDIA A100 umożliwia znaczące skrócenie czasu trenowania modeli AI oraz przyspieszenie ich działania w aplikacjach produkcyjnych.

Zastosowania w centrach danych i HPC

Akcelerator NVIDIA A100 jest projektowany z myślą o pracy w systemach serwerowych o wysokiej gęstości obliczeniowej. Pasywne chłodzenie oraz interfejs PCIe 4.0 x16 pozwalają na integrację z platformami serwerowymi i klastrami GPU wykorzystywanymi w:

- obliczeniach wysokiej wydajności (HPC)

- symulacjach naukowych

- analizie danych w centrach danych

- systemach sztucznej inteligencji

- platformach AI dla przedsiębiorstw

- infrastrukturze chmurowej GPU

Specyfikacja

| A100 80GB PCIe | A100 80GB SXM | |

|---|---|---|

| FP64 | 9,7 TFLOPS | 9,7 TFLOPS |

| Rdzenie Tensor FP64 | 19,5 TFLOPS | 19,5 TFLOPS |

| FP32 | 19,5 TFLOPS | 19,5 TFLOPS |

| Tensor Float 32 (TF32) | 156 TFLOPS | 312 TFLOPS* | 156 TFLOPS | 312 TFLOPS* |

| Rdzenie Tensor BFLOAT16 | 312 TFLOPS | 624 TFLOPS* | 312 TFLOPS | 624 TFLOPS* |

| Rdzenie Tensor FP16 | 312 TFLOPS | 624 TFLOPS* | 312 TFLOPS | 624 TFLOPS* |

| Rdzenie Tensor INT8 | 624 TOPS | 1248 TOPS* | 624 TOPS | 1248 TOPS* |

| Pamięć GPU | 80 GB HBM2e | 80 GB HBM2e |

| Przepustowość pamięci GPU | 1 935 GB/s | 2 039 GB/s |

| Maksymalny pobór mocy (TDP) | 300 W | 400 W *** |

| Wieloinstancyjne GPU (MIG) | Do 7 MIG po 10 GB każdy | Do 7 MIG po 10 GB każdy |

| Format karty | PCIe — podwójny slot (chłodzenie powietrzem) lub pojedynczy slot (chłodzenie cieczą) | SXM |

| Interfejs połączenia | Mostek NVIDIA® NVLink® dla 2 GPU: 600 GB/s ** PCIe Gen4: 64 GB/s |

NVLink: 600 GB/s PCIe Gen4: 64 GB/s |

| Opcje serwerowe | Partnerzy i systemy certyfikowane przez NVIDIA z 1–8 GPU | NVIDIA HGX™ A100 — partnerzy i systemy certyfikowane przez NVIDIA z 4, 8 lub 16 GPU NVIDIA DGX™ A100 z 8 GPU |

| Uwagi | *Z użyciem sparsity **Wymaga mostka NVLink ***Konfigurowalne |

|