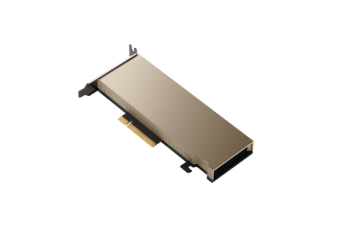

NVIDIA A2

Architektura GPU NVIDIA Ampere

Kompaktowy akcelerator GPU do obliczeń i grafiki

1280 rdzeni NVIDIA CUDA do równoległych obliczeń

40 rdzeni Tensor do przyspieszania obliczeń AI i deep learning

16 GB pamięci GPU do obsługi modeli AI i aplikacji analitycznych

Przepustowość pamięci do 200 GB/s

Interfejs PCIe 4.0 x16 zapewniający szybki transfer danych

Pasywne chłodzenie przeznaczone do serwerów i systemów edge

Bardzo niski pobór mocy: 40-60 W – idealny do systemów o wysokiej gęstości GPU

Darmowa dostawa

Promocja cenowa na model HDR-15-5

Produkt przeznaczony wyłącznie do zastosowań profesjonalnych

NVIDIA A2

Opis

NVIDIA A2 - energooszczędny akcelerator GPU dla AI na brzegu sieci

NVIDIA A2 Tensor Core GPU to kompaktowy akcelerator zaprojektowany z myślą o przyspieszaniu obliczeń sztucznej inteligencji w środowiskach o ograniczonej przestrzeni i niskim budżecie energetycznym. Karta oparta jest na architekturze NVIDIA Ampere i zapewnia wydajne wnioskowanie modeli AI (AI inference) w serwerach edge, centrach danych oraz systemach przemysłowych.

Dzięki niskoprofilowej konstrukcji PCIe Gen4 oraz konfigurowalnemu poborowi mocy w zakresie 40-60 W, NVIDIA A2 doskonale sprawdza się w serwerach o wysokiej gęstości GPU, systemach edge computing oraz platformach AI pracujących w trybie ciągłym.

Architektura NVIDIA Ampere dla obliczeń AI

GPU A2 wyposażony jest w 1280 rdzeni CUDA oraz 40 rdzeni Tensor, które przyspieszają operacje matematyczne wykorzystywane w systemach uczenia maszynowego i deep learningu. Dzięki temu akcelerator umożliwia efektywne przetwarzanie modeli AI bez konieczności stosowania dużych i energochłonnych GPU centrów danych.

Karta oferuje 16 GB pamięci GPU o przepustowości do 200 GB/s, co pozwala obsługiwać modele sztucznej inteligencji oraz aplikacje analityczne wymagające przetwarzania dużych strumieni danych.

AI inference i analiza danych w czasie rzeczywistym

NVIDIA A2 jest szczególnie zoptymalizowana pod kątem wnioskowania modeli AI w środowiskach produkcyjnych. Akcelerator pozwala na szybkie przetwarzanie modeli deep learning oraz analizę danych w czasie rzeczywistym.

GPU znajduje zastosowanie między innymi w:

- analizie obrazu i systemach vision AI

- inteligentnej analizie wideo (video analytics)

- systemach bezpieczeństwa i monitoringu

- inferencji modeli LLM i systemach konwersacyjnych

- platformach RAG (Retrieval Augmented Generation)

- analizie danych IoT

Idealny do systemów edge AI

Dzięki niewielkim wymiarom, pasywnemu chłodzeniu oraz niskiemu poborowi mocy, NVIDIA A2 może być instalowany w szerokiej gamie serwerów edge, komputerów przemysłowych oraz systemów przetwarzania danych blisko źródła ich powstawania.

Akcelerator jest wykorzystywany w rozwiązaniach takich jak:

- edge computing w przemyśle

- analiza wideo w inteligentnych miastach

- systemy autonomiczne i robotyka

- platformy AI w handlu i logistyce

- rozproszone systemy przetwarzania danych

Specyfikacja

| Maks. FP32 | 4,5 TF |

|---|---|

| Rdzenie Tensor TF32 | 9 TF | 18 TF¹ |

| Rdzenie Tensor BFLOAT16 | 18 TF | 36 TF¹ |

| Maks. Rdzenie Tensor FP16 | 18 TF | 36 TF¹ |

| Maks. Rdzenie Tensor INT8 | 36 TOPS | 72 TOPS¹ |

| Maks. Rdzenie Tensor INT4 | 72 TOPS | 144 TOPS¹ |

| Rdzenie RT | 10 |

| Silniki multimedialne | 1 enkoder wideo, 2 dekodery wideo (w tym dekodowanie AV1) |

| Pamięć GPU | 16 GB GDDR6 |

| Przepustowość pamięci GPU | 200 GB/s |

| Interfejs połączenia | PCIe Gen4 x8 |

| Format karty | 1-slot, niskoprofilowy PCIe |

| Maks. pobór mocy (TDP) | 40–60 W (konfigurowalne) |

| Obsługiwane oprogramowanie vGPU² | NVIDIA Virtual PC (vPC), NVIDIA Virtual Applications (vApps), NVIDIA RTX Virtual Workstation (vWS), NVIDIA AI Enterprise, NVIDIA Virtual Compute Server (vCS) |

¹ Z użyciem sparsity

² Obsługiwane w przyszłej wersji vGPU