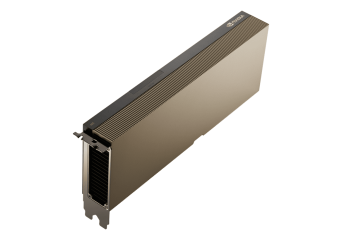

NVIDIA A30

Architektura GPU NVIDIA Ampere

Akcelerator GPU zoptymalizowany do AI, HPC i obliczeń w centrach danych

3584 rdzenie NVIDIA CUDA do równoległych obliczeń

224 rdzenie Tensor do przyspieszania modeli AI i deep learning

24 GB pamięci HBM2 z ECC do pracy z dużymi zbiorami danych

Przepustowość pamięci do 933 GB/s

Interfejs PCIe 4.0 x16 zapewniający wysoką przepustowość danych

Pasywne chłodzenie przeznaczone do serwerów i systemów obliczeniowych

Maksymalny pobór mocy: 165 W

Darmowa dostawa

Promocja cenowa na model HDR-15-5

Produkt przeznaczony wyłącznie do zastosowań profesjonalnych

NVIDIA A30

Opis

NVIDIA A30 - akcelerator GPU dla AI i obliczeń w centrach danych

NVIDIA A30 Tensor Core GPU to wydajny akcelerator zaprojektowany do obsługi wymagających obciążeń obliczeniowych w nowoczesnych centrach danych. Układ oparty na architekturze NVIDIA Ampere zapewnia wysoką wydajność w zadaniach związanych ze sztuczną inteligencją, analizą danych oraz obliczeniami wysokiej wydajności (HPC).

Dzięki dużej przepustowości pamięci, energooszczędnej konstrukcji oraz standardowemu interfejsowi PCIe, karta może być łatwo wdrażana w istniejącej infrastrukturze serwerowej. NVIDIA A30 stanowi doskonałą równowagę pomiędzy wydajnością, skalowalnością i efektywnością energetyczną.

Architektura NVIDIA Ampere i Tensor Cores

Akcelerator NVIDIA A30 wyposażony jest w 3584 rdzenie CUDA oraz 224 rdzenie Tensor, które przyspieszają operacje macierzowe wykorzystywane w uczeniu maszynowym i deep learningu.

Karta oferuje również 24 GB pamięci HBM2 z ECC oraz przepustowość sięgającą 933 GB/s, co umożliwia przetwarzanie dużych zbiorów danych oraz zaawansowanych modeli sztucznej inteligencji.

rdzenie CUDA

rdzenie Tensor

pamięci HBM2

przepustowości pamięci

Multi-Instance GPU (MIG) - elastyczne wykorzystanie GPU

Technologia Multi-Instance GPU (MIG) umożliwia podział pojedynczego akceleratora na kilka niezależnych instancji GPU. Każda z nich może obsługiwać oddzielne obciążenia obliczeniowe, zapewniając izolację zasobów oraz przewidywalną wydajność.

Dzięki temu NVIDIA A30 może jednocześnie obsługiwać wiele aplikacji AI lub użytkowników w środowiskach chmurowych i centrach danych.

Zastosowania GPU w AI i analityce danych

NVIDIA A30 jest szeroko wykorzystywana w środowiskach sztucznej inteligencji oraz analizy danych, gdzie kluczowa jest wysoka wydajność obliczeń równoległych.

LLM, chatboty, generatywna AI

VLM, analiza obrazu i tekstu

AI z bazą wiedzy przedsiębiorstwa

big data i analityka biznesowa

symulacje naukowe i inżynierskie

skalowalne klastry GPU

GPU dla skalowalnej infrastruktury serwerowej

Dzięki pasywnemu chłodzeniu oraz interfejsowi PCIe 4.0 x16, NVIDIA A30 jest przeznaczona do pracy w serwerach i klastrach GPU o wysokiej gęstości obliczeniowej.

Maksymalny pobór mocy wynoszący 165 W pozwala na efektywne wykorzystanie energii przy zachowaniu wysokiej wydajności obliczeniowej.

Specyfikacja

| FP64 | 5,2 teraFLOPS |

|---|---|

| Rdzenie Tensor FP64 | 10,3 teraFLOPS |

| FP32 | 10,3 teraFLOPS |

| Rdzenie Tensor TF32 | 82 teraFLOPS | 165 teraFLOPS* |

| Rdzenie Tensor BFLOAT16 | 165 teraFLOPS | 330 teraFLOPS* |

| Rdzenie Tensor FP16 | 165 teraFLOPS | 330 teraFLOPS* |

| Rdzenie Tensor INT8 | 330 TOPS | 661 TOPS* |

| Rdzenie Tensor INT4 | 661 TOPS | 1321 TOPS* |

| Silniki multimedialne | 1 akcelerator przepływu optycznego (OFA) 1 dekoder JPEG (NVJPEG) 4 dekodery wideo (NVDEC) |

| Pamięć GPU | 24 GB HBM2 |

| Przepustowość pamięci GPU | 933 GB/s |

| Interfejs połączenia | PCIe Gen4: 64 GB/s Trzecia generacja NVLink: 200 GB/s** |

| Format karty | Podwójny slot, pełna wysokość i długość (FHFL) |

| Maksymalny pobór mocy (TDP) | 165 W |

| Wieloinstancyjne GPU (MIG) | 4 instancje GPU po 6 GB każda 2 instancje GPU po 12 GB każda 1 instancja GPU 24 GB |

| Obsługiwane oprogramowanie vGPU | NVIDIA AI Enterprise, NVIDIA Virtual Compute Server |

* Z użyciem sparsity

** Mostek NVLink dla maksymalnie dwóch GPU