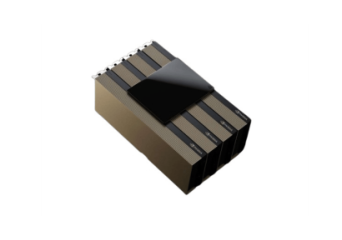

NVIDIA H200 NVL

Architektura GPU NVIDIA Hopper

Akcelerator GPU zoptymalizowany do generatywnej AI i obliczeń HPC

14592 rdzenie NVIDIA CUDA do obliczeń równoległych na dużą skalę

456 rdzeni NVIDIA Tensor do trenowania i inferencji modeli AI

141 GB pamięci HBM3e z ECC – ogromna przestrzeń dla największych modeli AI

Przepustowość pamięci do 4,8 TB/s

Interfejs PCIe 5.0 x16 zapewniający bardzo wysoką przepustowość danych

Pasywne chłodzenie przeznaczone do serwerów i klastrów GPU

Maksymalny pobór mocy: 600 W

Darmowa dostawa

Promocja cenowa na model HDR-15-5

Produkt przeznaczony wyłącznie do zastosowań profesjonalnych

NVIDIA H200 NVL

Opis

NVIDIA H200 NVL - akcelerator GPU dla generatywnej AI i największych modeli LLM

NVIDIA H200 Tensor Core GPU to jeden z najnowszych i najbardziej zaawansowanych akceleratorów obliczeniowych zaprojektowanych dla infrastruktury sztucznej inteligencji oraz obliczeń wysokiej wydajności (HPC). Układ oparty na architekturze NVIDIA Hopper zapewnia przełomową wydajność oraz ogromną przepustowość pamięci, umożliwiając obsługę najbardziej wymagających obciążeń AI.

GPU H200 NVL został zaprojektowany z myślą o trenowaniu i uruchamianiu bardzo dużych modeli sztucznej inteligencji, w tym systemów generatywnej AI wykorzystywanych w przedsiębiorstwach oraz centrach danych. Dzięki nowej generacji pamięci HBM3e akcelerator oferuje znacząco większą przepustowość oraz pojemność pamięci niż wcześniejsze generacje GPU.

Architektura NVIDIA Hopper i pamięć HBM3e

Akcelerator wykorzystuje architekturę NVIDIA Hopper, która została zaprojektowana z myślą o maksymalnym przyspieszeniu obliczeń AI. GPU wyposażony jest w 14592 rdzenie CUDA oraz 456 rdzeni Tensor, które przyspieszają operacje matematyczne wykorzystywane w deep learningu.

Najważniejszą innowacją H200 jest zastosowanie 141 GB pamięci HBM3e z korekcją błędów ECC oraz przepustowości sięgającej 4,8 TB/s. Dzięki temu GPU może obsługiwać największe modele sztucznej inteligencji oraz ogromne zbiory danych wykorzystywane w nowoczesnych systemach AI.

rdzenie CUDA

rdzenie Tensor

pamięci HBM3e

przepustowości pamięci

GPU dla generatywnej sztucznej inteligencji

NVIDIA H200 NVL jest projektowany jako akcelerator dla najbardziej zaawansowanych systemów generatywnej sztucznej inteligencji. GPU umożliwia trenowanie ogromnych modeli AI oraz ich szybkie wdrażanie w środowiskach produkcyjnych.

trenowanie i inferencja modeli LLM

VLM i systemy łączące tekst, obraz i wideo

AI korzystająca z wiedzy przedsiębiorstwa

platformy AI-as-a-Service

big data i analityka AI

obliczenia naukowe i badawcze

Akcelerator dla centrów danych nowej generacji

GPU NVIDIA H200 NVL został zaprojektowany do pracy w nowoczesnych platformach serwerowych oraz klastrach GPU wykorzystywanych w centrach danych. Interfejs PCIe 5.0 x16 zapewnia bardzo wysoką przepustowość komunikacji między GPU a systemem serwerowym.

Dzięki pasywnemu chłodzeniu oraz maksymalnemu poborowi mocy wynoszącemu 600 W, akcelerator jest przeznaczony do pracy w profesjonalnej infrastrukturze AI oraz systemach HPC obsługujących najbardziej wymagające obciążenia.

GPU dla infrastruktury AI i superkomputerów

Rosnąca złożoność modeli sztucznej inteligencji powoduje zapotrzebowanie na ogromną moc obliczeniową oraz bardzo dużą przepustowość pamięci. NVIDIA H200 NVL odpowiada na te potrzeby, umożliwiając budowę skalowalnych platform AI wykorzystywanych w przedsiębiorstwach, centrach danych oraz instytutach badawczych.

Akcelerator stanowi kluczowy element infrastruktury wykorzystywanej do trenowania największych modeli sztucznej inteligencji oraz prowadzenia zaawansowanych obliczeń naukowych.

Specyfikacja

| Specyfikacja | H200 SXM | H200 NVL |

|---|---|---|

| FP64 | 34 TFLOPS | 30 TFLOPS |

| FP64 Tensor Core | 67 TFLOPS | 60 TFLOPS |

| FP32 | 67 TFLOPS | 60 TFLOPS |

| TF32 Tensor Core² | 989 TFLOPS | 835 TFLOPS |

| BFLOAT16 Tensor Core² | 1 979 TFLOPS | 1 671 TFLOPS |

| FP16 Tensor Core² | 1 979 TFLOPS | 1 671 TFLOPS |

| FP8 Tensor Core² | 3 958 TFLOPS | 3 341 TFLOPS |

| INT8 Tensor Core² | 3 958 TFLOPS | 3 341 TFLOPS |

| Pamięć GPU | 141 GB | 141 GB |

| Przepustowość pamięci GPU | 4,8 TB/s | 4,8 TB/s |

| Dekodery | 7 NVDEC 7 JPEG |

7 NVDEC 7 JPEG |

| Bezpieczne obliczenia (Confidential Computing) | Obsługiwane | Obsługiwane |

| Maks. pobór mocy (TDP) | Do 700W (konfigurowalne) | Do 600W (konfigurowalne) |

| Wiele instancji GPU (MIG) | Do 7 MIG po 18GB | Do 7 MIG po 16,5GB |

| Format | SXM | PCIe Dwuslotowe, chłodzenie powietrzem |

| Połączenia | NVIDIA NVLink: 900GB/s PCIe Gen5: 128GB/s |

Mostek NVIDIA NVLink 2- lub 4-kierunkowy: 900GB/s na GPU PCIe Gen5: 128GB/s |

| Opcje serwerowe | Partnerzy NVIDIA HGX H200 i systemy NVIDIA-Certified z 4 lub 8 GPU | Partnerzy NVIDIA MGX H200 NVL i systemy NVIDIA-Certified z maks. 8 GPU |

| Dodatek NVIDIA AI Enterprise | W zestawie | W zestawie |

¹ Specyfikacje wstępne, mogą ulec zmianie.

² Z uwzględnieniem rzadkości (sparsity).